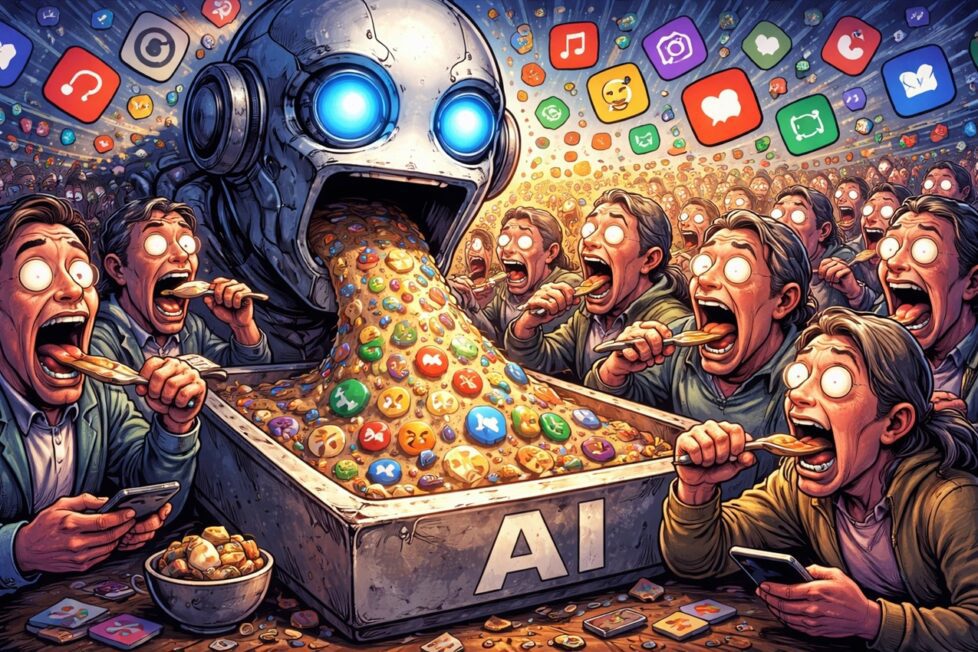

Humanidad Slop

Humanidad Slop, por Juan Jesús Jiménez: Las personas que usan la I.A. de forma irresponsable, son slop. Porque en su papel de no tomar responsabilidad por su uso, dotan a un programa de una cualidad que no poseen la capacidad de discernimiento y de elección para tomar una postura