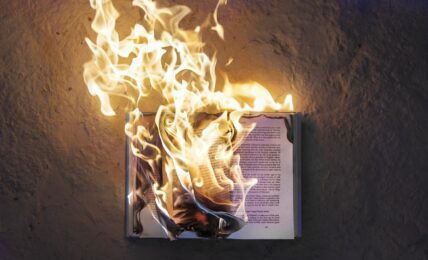

Máquinas pensantes

Atribuirles a las máquinas características y conflictos humanos sin considerar la complejidad de nuestra propia naturaleza no solo es inexacto, sino que limita nuestra capacidad de comprender tanto a la inteligencia artificial como a nosotros mismos. Un artículo de Ana Gabriela Banquez Maturana.